Secondo un ingegnere in forza a Google, ora licenziato, l’azienda avrebbe creato un’intelligenza artificiale con anima e coscienza

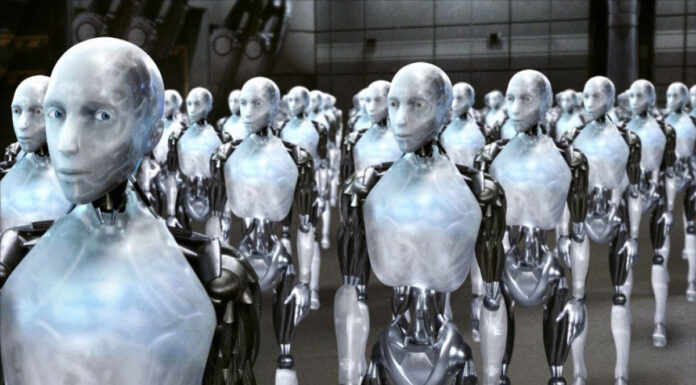

LaMDA: questo il nome di quella che secondo un ingegnere di Google sarebbe la prima intelligenza artificiale completamente senziente. Si tratta di uno strumento interno all’azienda, Language Model for Dialogue Applications, che questo tale Blake Lemoine insiste sarebbe una I.A. cosciente come quelle dei film di fantascienza.

Skynet, oppure GLaDOS, o anche il buon vecchio HAL 9000? Lemoine, un reduce che si è descritto anche come un sacerdote, nonché ex-detenuto e ricercatore I.A., ha detto ai capi di Google che secondo lui LaMDA sarebbe “[l’equivalente di] un bambino di 7 o 8 anni“. E ha chiesto all’azienda di domandare alla I.A. “il permesso” prima di utilizzarla per esperimenti.

“Hanno ripetutamente messo in discussione la mia sanità mentale”, ha detto Lemoine. Ora l’ingegnere è stato allontanato (ma è sempre a libro paga) con l’accusa di aver violato “le politiche di confidenzialità di Google“. Nello specifico Lemoine avrebbe informato un senatore degli Stati Uniti (non si sa chi) del fatto che Google adotterebbe discriminazioni religiose.

Questo ha direttamente a che vedere col fatto che l’idea che Lemoine si è creato della natura della I.A. ha a che fare con le sue credenze religiose; e il fatto che non gli si dia credito è stato da lui interpretato come discriminazione. Arriviamo però al punto: davvero questa I.A. è senziente e dotata di “coscienza”?

La risposta di Google è subito no. Il sistema può sì imitare conversazioni reali ed affrontare diversi argomenti, questo non significa certo che possegga una coscienza. Si tratta in effetti di una rete neurale: ossia, di un sistema matematico che apprende abilità analizzando grandi quantità di dati.

L’esempio del New York Times: se un sistema come quello di LaMDA analizzasse i pattern di migliaia di foto di gatti, saprebbe riconoscere un gatto. Detto questo, sostiene Yann LeCun, capo della A.I. research di Meta ed esperto in materia, questo genere di sistemi non sono abbastanza potenti per arrivare ad avvicinarsi alla vera intelligenza.

Si stima che questi sistemi, sempre imparando da una enorme quantità di dati, possano riassumere articoli, rispondere a domande, generare tweet e persino scrivere post su blog. Ma l’intelligenza umana è tutta un’altra cosa, ovviamente. E per quanto la tecnologia stia facendo passi da gigante, una vera I.A. senziente sembra ancora di là da venire.

Sulle dichiarazioni di Lemoine ha detto per esempio Emaad Khwaja, ricercatore della University of California: “Se utilizzi questi sistemi, non diresti mai cose del genere”. Brian Gabriel, portavoce di Google, ha dichiarato: “Alcuni nell’ampia comunità [di persone interessate all’argomento] I.A. considerano la possibilità a lungo termine di una I.A. senziente o generale”.

“Ma non ha senso farlo antropomorfizzando i modelli di conversazione di oggi, che non sono senzienti”. In altre parole, per quanto convincenti le conversazioni che si possono intrattenere con LaMDA non si devono scambiare con la complessità di interazioni reali e umane. E perciò, neanche la macchina stessa è da considerarsi senziente.

Sempre secondo Google centinaia di ricercatori ed ingegneri hanno intrattenuto conversazioni con LaMDA, raggiungendo però conclusioni ben diverse rispetto a quelle di Lemoine. Solo una convizione di una persona con la testa non proprio a posto, quindi? Forse non lo sapremo mai. In ogni caso, per la comunità scientifica l’arrivo di una I.A. senziente e cosciente è ancora più un mito che realtà.

Fonte: The New York Times

Continuate a seguirci su LaScimmiaPensa